Deep Learning ontsluiten voor de zorg

Machine Learning (ML) heeft de potentie om binnen de zorg uit te groeien tot een essentieel hulpmiddel voor diagnosticeren en het kiezen van de meest geschikte behandeling. Het op basis van data de juiste afwegingen maken in het kiezen tot behandeling kan een versneller zijn in dit lastige en moeilijk duidbare proces. Toch wordt ML maar heel beperkt toegepast in de gezondheidszorg en de reden daarvoor is transparantie. Met name Deep Learning (DL) is daarvoor een uitdaging, omdat dit een blackbox is zonder expliciete kennisrepresentatie.

Onderdeel van:

Machine Learning en Deep Learning met Medische beelden

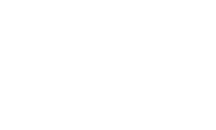

Wat is ervoor nodig om AI als tool inzetbaar te maken in de gezondheidszorg? Een begin van een oplossing lijkt te liggen in de beginjaren van AI, waar een model een expliciete encodering is van een decision tree (DT). Deze DT was vaak uitgewerkt door een expert en de specifieke touchpoints die deze hanteert in zijn besluitvorming. Deze modellen waren dus uitlegbaar, en bieden een ‘vereenzelviging met de kennispresentatie van het system’. Deze modellen zijn echter niet zo krachtig als DL modellen, maar in een combinatie van een DT en DL ligt een mogelijke oplossing door grote nauwkeurigheid te combineren met uitlegbaarheid. Niet door elke stap van het proces in een DL model uit te leggen, maar met hints die tot een diagnose geleid hebben. Bijvoorbeeld, een model dat huidkanker constateert geeft de dermatoloog niet alleen een diagnose, maar ook een uitleg die begrijpelijk is voor de dermatoloog en correspondeert met dienst methoden. Deze hints zijn bijvoorbeeld visuele kenmerken van een medisch beeld die bijdragen aan de nauwkeurigheid en uitlegbaarheid van een model.

Fig. 1. Door DL en DT te combineren, opent zich een derde weg voor een transparante inzet van DL

Onderzoeksvraag:

Hoe kunnen we deep learning ontsluiten voor medische professionals als betrouwbare en transparante (ondersteunende) beslissingstool?

Generale toepassing:

Het ontsluiten van besluitprocessen in deep learning oplossingen, kan de techniek meer acceptabel maken voor legio toepassingen waar transparantie noodzakelijk is. Bovendien vergroot het de uitlegbaarheid en nauwkeurigheid van het model. Dit kan op zijn beurt bijdragen aan een bredere acceptatie van deep learning en AI.

Onderzoeksperiode:

2019 - 2024

Methodiek & Bevindingen

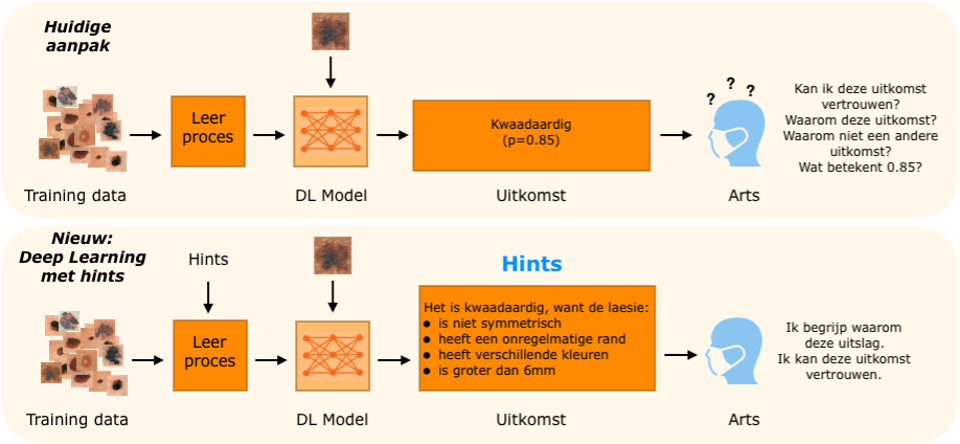

Fig. 2. Hints ontsluiten door middel van een met een selectieve reeks ‘bewijs’ het black box element van DL.

In dit onderzoek wordt de toepassing onderzocht met betrekking tot huidaandoeningen. Door hints te gebruiken wordt duidelijk welke verzameling van visuele kenmerken in het interpreteerbare domein hebben bijgedragen aan een gegeven huidlaesie om een beslissing te produceren. Bij de output van het model worden kenmerken getoond, die eerder werden geïnterpreteerd door een arts. Op deze manier zorgt DL voor de nauwkeurigheid en hints voor de uitlegbaarheid.

Om dit mogelijk te maken, moeten de bestaande datasets aangevuld worden met medische beelden die visuele kenmerken bevatten. Deze kunnen op verschillende manieren verzameld worden:

- Experts leveren deze aan

- Computeralgoritmes genereren deze

- Winning door crowdsourcing (publiek online assisteert om hints te verzamelen).

Elke methode heeft voor- en nadelen. Expert hints zijn heel uitlegbaar, maar duur om te verzamelen. Computeralgoritmes zijn makkelijk beschikbaar, maar staan verder af van een expliciete kennisrepresentatie en ‘tastbaarheid’. Crowd hints zijn relatief makkelijk te verzamelen, echter is de kwaliteit niet gegarandeerd.

In het door NWO gefinancierde onderzoek (promotiebeurs voor leraren) willen wij aantonen wat de introductie van hints met de uitlegbaarheid en nauwkeurigheid doet. De looptijd bedraagt 5 jaar (tot eind 2024).

Onderzoeksteam

- Drs. Ing. Ralf Raumanns, Fontys Hogeschool ICT (Projectleiding)

- Dr. Ir. Gerard Schouten, Fontys Hogeschool ICT (co-promotor)

- Dr. Veronika Cheplygina, ITU Copenhagen (co-promotor)

- Prof. Dr. Josien Pluim, Technische Universiteit Eindhoven (co-promotor)